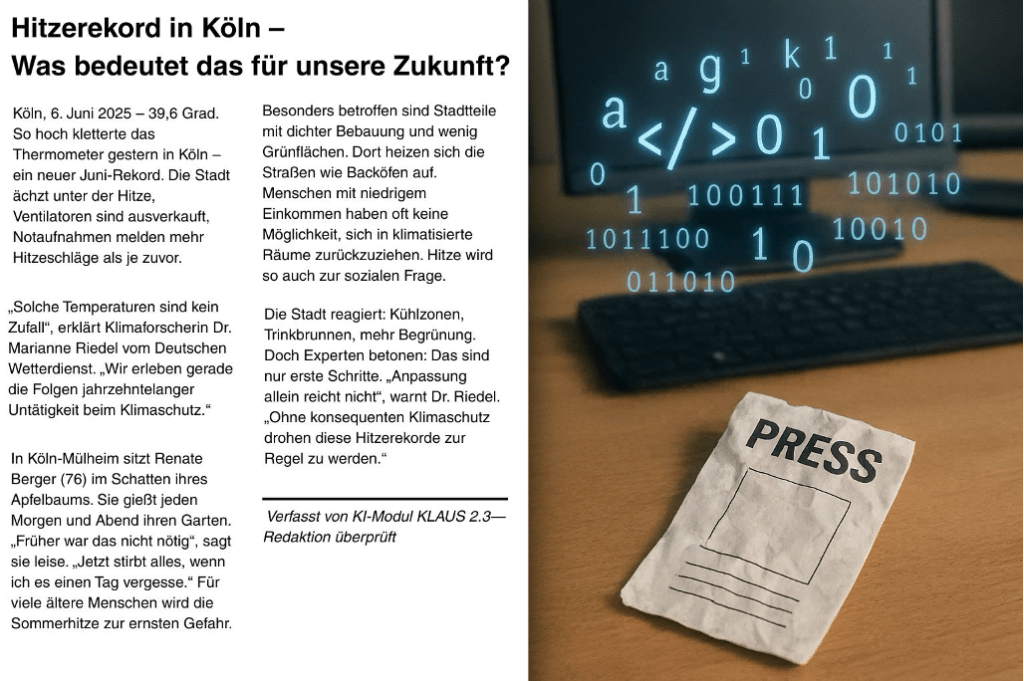

Als Lena [1] an diesem Morgen die Zeitung aufschlägt, fällt ihr sofort der Artikel auf Seite drei ins Auge: – „Hitzerekord in Köln – Was bedeutet das für unsere Zukunft?“ Flüssig geschrieben, mit gut recherchierten Daten – sogar ein emotionales Zitat einer Rentnerin, die sich Sorgen um ihren Garten macht. Nur eine kleine Fußnote unter dem Text lässt sie stutzen: „Verfasst von KI –Modul KLAUS 2.3, Redaktion überprüft.“ Lena runzelt die Stirn. Hätte sie es nicht gelesen, wäre es ihr nicht aufgefallen. Die Geschichte wirkt menschlich. Kein Gramm Technik, kein starrer Stil. KLAUS schreibt wie ein erfahrener Redakteur. Aber was bedeutet das für sie? Für ihre Zukunft als Journalistin?

[1] Lena ist eine fiktive Figur.

KI als Werkzeug: Realität statt Dystopie

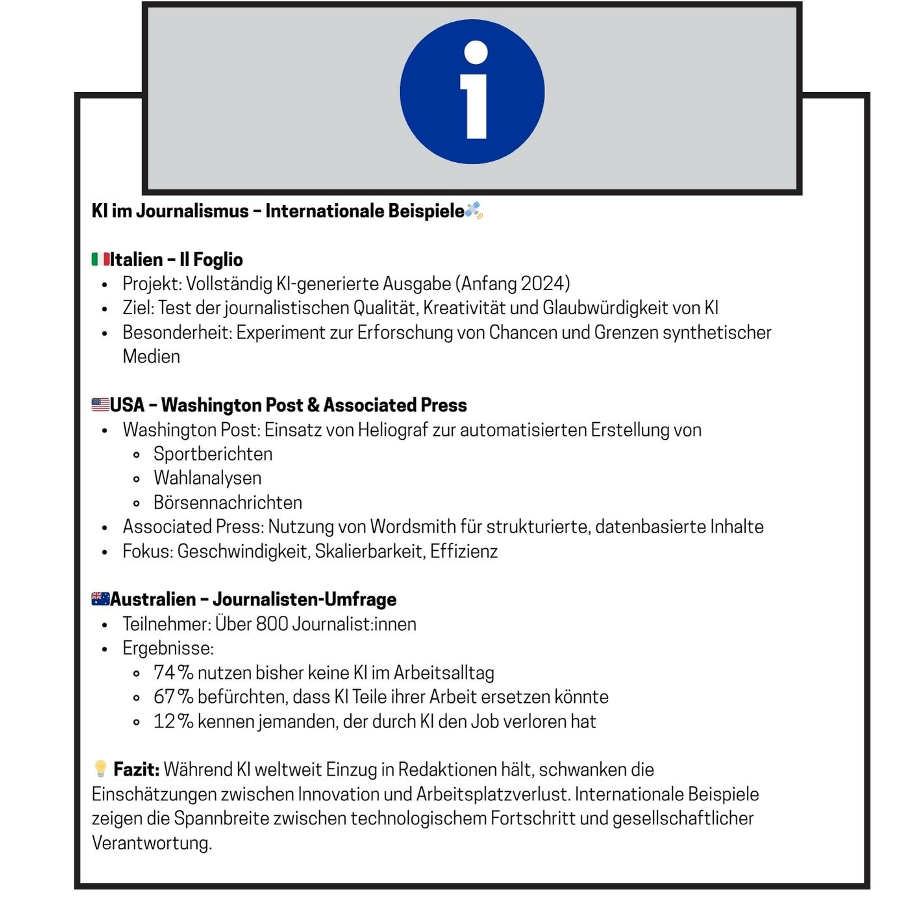

Die Vorstellung, dass ein Algorithmus journalistische Aufgaben übernimmt, wirkt auf viele im ersten Moment bedrohlich. Doch was nach Dystopie klingt, ist längst Realität. Redaktionelle Prozesse verändern sich rasant, seit Systeme wie ChatGPT oder spezialisierte News – Algorithmen fester Bestandteil redaktioneller Abläufe geworden sind.

Dabei steht nicht nur die technische Entwicklung im Mittelpunkt, sondern eine tiefere Frage: Was bleibt vom journalistischen Selbstverständnis, wenn Maschinen Texte schreiben können? Die Antwort darauf ist nicht eindeutig. Künstliche Intelligenz im Journalismus ist ein Spannungsfeld aus Hoffnung, Zweifel und notwendigem Diskurs.

Zahlreiche Redaktionen setzen heute bereits auf künstliche Intelligenz, aber nicht, wie viele vermuten, um Menschen zu ersetzten, sondern um sie zu unterstützen. Der Kölner Stadtanzeiger etwa experimentierte schon vor dem ChatGPT–Hype mit Machine Learning und Collaborative Filtering. Ziel war es, Inhalte besser an Leserbedürfnisse anzupassen. Das Ergebnis: ein personalisiertes Empfehlungssystem, das die Klickrate auf der Startseite um stolze 80 Prozent erhöhte. Die Redaktion gewann dadurch keine freie Zeit, sondern aber eine präzise Verbindung zu ihrem Publikum.

Mit der virtuellen Redakteurin Klara Indernach, die kein Mensch, sondern ein KI–System ist, haben die Kölner Stadtanzeiger Medien bewusst ein Szenario eingeführt, das veranschaulichen soll, wie automatisierte Textproduktion im journalistischen Alltag konkret aussehen kann. Etwa vier Prozent der Beiträge stammen von ihr, selbstverständlich redigiert von menschlichen KollegInnen. Das Beispiel verdeutlicht: Die Maschine übernimmt routinierte, datenlastige Aufgaben und schafft so Freiraum für tiefere Recherchen – ohne journalistische Kompetenz zu untergraben oder unmittelbar Arbeitsplätze zu gefährden.

Automatisierte Inhalte – und die Skepsis des Publikums

Technisch geht der Bayrische Rundfunk noch weiter: Das „AI + Automation Lab“ bringt Informatik, Journalismus und Produktentwicklung an einen Tisch. Eines ihrer Projekte, das „BR Regional–Update“, erlaubt es Hörern, sich personalisierte Audio–Nachrichten für ihre Region zusammenzustellen zu lassen. Was früher ein umfassender redaktioneller Aufwand war, wird heute von Algorithmen vorbereitet – präzise, zielgruppengerecht, jederzeit abrufbar.

Ein weiteres Beispiel liefert der SWR mit dem Podcast „Joystick&Journalismus“. Die Hosts? Zwei KI–generierte Avatare, die durch ein vom Sender aufbereitetes Whitepaper zum Thema Gaming bewegen. Der Podcast ist ein Experiment: Wie lassen sich trockene Fakten so präsentieren, dass sie ein junges Publikum tatsächlich erreichen? Der Content stammt zwar aus menschlicher Hand, doch die Aufbereitung und Präsentation sind vollautomatisiert.

Und dabei: Die Leserinnen und Leser spüren, dass sich etwas verändert. Studien wie die der Hamburger Standortinitiative nextMedia.Hamburg zeigen, dass 82 Prozent der Deutschen KI–generierten Medieninhalten skeptisch gegenüberstehen. Nur 4 Prozent äußerten hohes Vertrauen und 13 Prozent waren unentschlossen. Ein möglicher Grund: ein mangelndes Bewusstsein über Chancen und Grenzen der Technologie.

Einordnung braucht Haltung – und Verantwortung

KI produziert Inhalte in Sekundenschnelle, spart Personalkosten, braucht keinen Urlaub, macht keine Fehler. Wirtschaftlich gesehen ist die Rechnung einfach, für die Gesellschaft jedoch viel komplizierter. „Der Einsatz von KI wird die Medienwelt tiefgreifend verändern. Dass dies keine Zukunftsmusik mehr ist, zeigt die aktuelle Debatte um ChatGPT. Redaktionen sollten KI als Hilfsmittel nutzen, zum Vorteil für Journalistinnen und Journalisten, als auch für das Medienpublikum. Gleichzeitig müssen Medienschaffende, Aufsichtsgremien und Politik den KI – basierten Journalismus so lenken und gestalten, dass er weiterhin seinem demokratischen Auftrag gerecht wird“, so Christoph Neuberger, Publizistikprofessor der Freien Universität Berlin in einem acatech-Bericht vom 23.1.2023 (abgerufen am 31.12.2025).

Denn Journalismus war nie nur das schnelle Weiterreichen von Fakten. Es war immer auch eine Einordnung, Kritik und Empathie. Eigenschaften, die Algorithmen nicht kennen. Sie kombinieren Wörter, aber sie tragen keine Verantwortung, hinterfragen keine Macht, machen kein Unrecht sichtbar.

All diese Entwicklungen zeigen: Der Journalismus wird nicht ersetzt, sondern erweitert. KI kann Stütze, Werkzeug, Filter oder Vorschlagssystem sein. Was sie nicht kann – und das bleibt essenziell – ist Einordnung, Haltung, Kontext. Sie schreibt, aber versteht nicht. Und gerade in einer Zeit, in der sich gesellschaftliche Debatten zuspitzen und Desinformation zur Gefahr für die Demokratie wird, bleibt dieser Unterschied entscheidend.

Neue Regeln, neue Rollen – aber klare Grenzen

Das spiegelt sich auch in der Branche selbst wider. Laut einer Studie des WDR sehen 69 Prozent der Entscheider in Medienunternehmen KI als zentralen Innovationstreiber der kommenden Jahre. Der digitale Wandel ist unausweichlich und wer ihn mitgestaltet, kann seine Richtung beeinflussen. Doch damit das gelingt, braucht es klare Regeln.

Transparenz spielt dabei eine zentrale Rolle. Wenn ein Text von einer Maschine stammt, sollte das deutlich gekennzeichnet sein – nicht als Stigma, sondern als Information. Nur durch nachvollziehbare Prozesse und ehrliche Kommunikation kann Vertrauen entstehen. Für Eva Flecken, Direktorin der Konferenz der Landesmedienanstalten, ist entscheidend, dass wir die Balance zwischen den Chancen und Risiken künstlicher Intelligenz wahren. Das gehe nur mit klaren Vorgaben, erklärt sie in einer öffentlichen Stellungnahme vom 11.12.2024 auf der Internetseite der Medienanstalten (abgerufen am 31.12.2025).

Auch Prof. Christian Krebs, Mitinitiator des Transparenzchecks ergänzt in der gleichen Stellungsnahme: Es reiche nicht, KI technisch zu beherrschen – es brauche eine ethische Haltung, die im Redaktionsalltag gelebt wird.

Ein Gegenmodell verfolgt die WELT–Redaktion. Nach eigenen Angaben versteht sie KI als ein Werkzeug zur Effizienzsteigerung. Automatisiert werden Börsenkurse, Wahlergebnisse und Sportdaten – deutlich gekennzeichnet. Tiefere Analysen und politische Kommentare bleiben in menschlicher Hand. Ihre Haltung: KI wird den Journalismus beeinflussen, aber nicht ersetzen. Entscheidend sei, dass Redaktionen selbst bestimmen, welche Aufgaben sie der Technik überlassen, und welche nicht.

Sicherheits – und Qualitätsstandards müssen ebenso mitwachsen. KI – Systeme, die in Redaktionen arbeiten, sollen zertifiziert und regelmäßig überprüft werden – nicht nur technisch, sondern ebenso ethisch. Denn wer entscheidet, was relevant ist? Wer programmiert, was „neutral“ bedeutet?

Auch rechtlich hängt die Entscheidung noch hinterher. Das Presserecht muss erweitert, journalistische Sorgfalt neu definiert und Urheberrechte angepasst werden. Besonders heikel wird es dort, wo Sprachmodelle fremde Inhalte paraphrasieren, analysieren oder imitieren. Ein Text, der wie eine originelle Recherche klingt, könnte am Ende nur das Produkt statistischer Mustererkennung sein.

Die SPD-nahe Friedrich–Ebert–Stiftung weist in ihrer aktuellen Analyse darauf hin, dass journalistische Redaktionen dringend ethische Richtlinien für den Umgang mit KI brauchen. Auch acatech, die Deutsche Akademie der Technikwissenschaften, betont die Notwendigkeit neuer Berufsbilder. KI-KoordinatorInnen, die Technik, Ethik und Redaktion zusammenführen, – etwa ausgebildet durch Programme wie das „KI-Koordinator (TÜV)“ Seminar der TÜV Rheinland Akademie.

KI kann schreiben – aber nicht erzählen

Trotz aller Fortschritte bleibt eine Grenze bestehen: die journalistische Haltung. Eine Maschine kann Informationen strukturieren, doch sie kennt kein Verantwortungsgefühl. Sie kann Stimmungen analysieren, aber keine Position beziehen. Zweifel, Widerspruch und Empathie, die den Journalismus ausmachen, sind nicht programmierbar.

Statt also zu fragen, ob KI den Journalismus ersetzt, sollten wir uns fragen: Wie wollen wir unsere Zukunft gestalten? Die Antwort darauf kann nicht allein aus Algorithmen kommen, sie muss von uns kommen.

Von Redaktionen, die sich nicht mit synthetischer Effizienz zufriedengeben. Von JournalistInnen, die Haltung zeigen, auch wenn sie gegen den Strom schwimmen. Von einer Öffentlichkeit, die nicht nur klickt, sondern hinterfragt. Denn wenn wir zulassen, dass Geschwindigkeit wichtiger wird als Tiefe, wenn wir Geschichten durch Datensätze ersetzten und Haltung durch Statistik, dann verlieren wir mehr als Jobs. Dann verlieren wir Vertrauen. Orientierung. Demokratie.

Der Journalismus der Zukunft braucht Technologie, aber er braucht vor allem Menschen, die Verantwortung übernehmen. Er braucht Redaktionen, die in Vielfalt, Transparenz und Qualität investieren. Und er braucht Leserinnen und Leser, die nicht nur Informationen konsumieren, sondern eine freie Presse als gemeinsames Gut begreifen.

Der Algorithmus kann schreiben, aber erzählen – wirklich erzählen – das können nur wir. Die Frage ist nicht mehr, was KI kann. Die Frage ist: Was sind wir bereit, ihr zu überlassen und was nicht? Jetzt ist die Zeit, das zu entscheiden.

Titelbild: Laptop und Zeitung, Foto von Lana Nagl